Gradientenabstieg und Kosten

- 24-07-2022

- chuong xuan

- 0 Comments

Warum ist Gradient Descent beim maschinellen Lernen wichtig? Der Algorithmus arbeitet iterativ, um die Verlustfunktion zu optimieren. Die Verlustfunktion beschreibt, wie gut das Modell mit zusätzlichen Zahlen (Gewichtungen und Verzerrungen) abschneidet. Der Gradientenabstieg wird verwendet, um den besten Parameter zu finden. Beispiel zum Aktualisieren von Parametern für die lineare Regression oder Gewichtungen im neuronalen Netzwerk.

Mục lục

Was ist die Kostenfunktion?

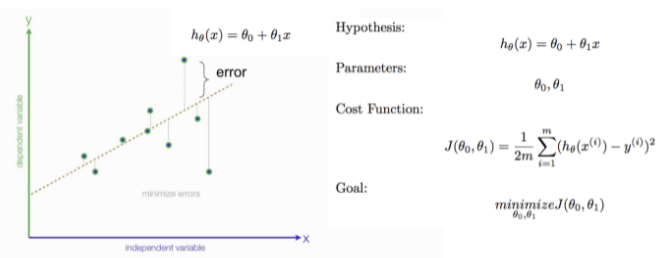

Die Kostenfunktion (oder Verlustfunktion) hilft, die Kosten zu bestimmen, um die Vorhersagbarkeit der Ausgabe auf dem Testsatz zu messen. Ziel ist es, Gewichtungen und Bias zu finden, die die Kosten minimieren. Und verwenden Sie MSE (mittlerer quadratischer Fehler), um die Differenz zwischen dem wahren Wert von y und dem vorhergesagten Wert zu messen. Die Regressionsgleichung ist eine gerade Linie der Form hθ( x ) = θ + θ1x, wobei Gewicht (θ1) und Bias ( θ0 ) sind.

Optimierung der Kostenfunktion.

Fast das Hauptziel von Modellen für maschinelles Lernen besteht darin, zur Kostenoptimierung beizutragen.

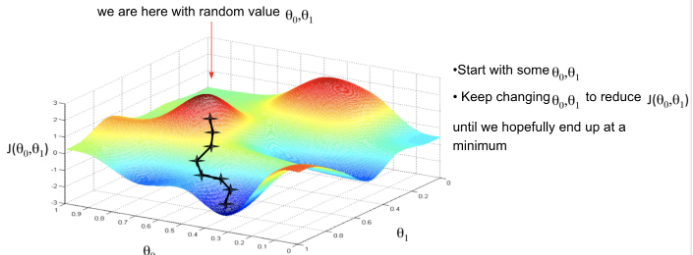

Die Idee ist, die roten Spitzen zu den blauen Tiefs zu bringen. Dazu müssen wir die Gewichte θ0 und θ1 anpassen.

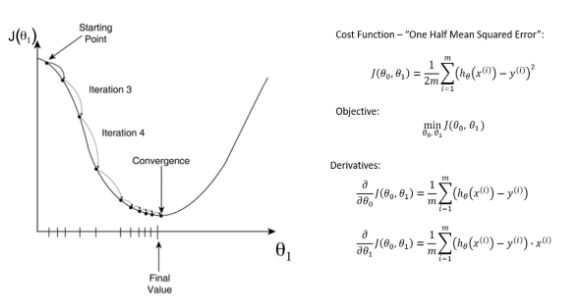

Gradient Descent wird iterativ ausgeführt, um die optimalen Werte der entsprechenden Parameter zu finden, um die Optimierung der Kostenfunktion zu unterstützen. Mathematisch hilft uns die Ableitung, die Kostenfunktion zu minimieren und den Minimalpunkt zu bestimmen.