Gradient Descent and Cost

- 24-07-2022

- chuong xuan

- 0 Comments

Por que o Gradient Descent é importante no aprendizado de máquina? O algoritmo executa iterativamente para otimizar a função de perda. A função de perda descreve o desempenho do modelo com números extras (pesos e vieses), o gradiente descendente é usado para encontrar o melhor parâmetro. Exemplo de atualização de parâmetros para Regressão Linear ou pesos em rede neural.

Mục lục

O que é função de custo?

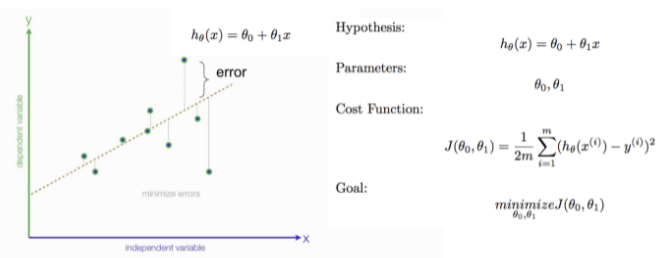

A função de custo (ou função de perda) ajuda a determinar o custo para medir a previsibilidade da saída no conjunto de teste. O objetivo é encontrar pesos e vieses que minimizem os custos. E use MSE (mean squared error) para medir a diferença entre o valor verdadeiro de y e o valor previsto. A equação de regressão é uma linha reta da forma hθ( x ) = θ + θ1x, onde peso (θ1) e viés ( θ0 ) .

Otimização da função de custo.

Quase o principal objetivo dos modelos de Machine Learning é ajudar a otimizar custos.

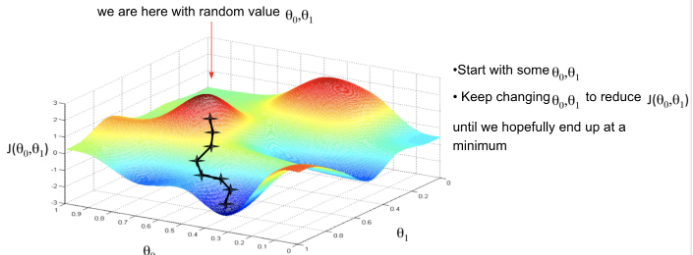

A ideia é trazer os picos vermelhos para os baixos azuis. Para fazer isso, precisamos ajustar os pesos θ0 e θ1.

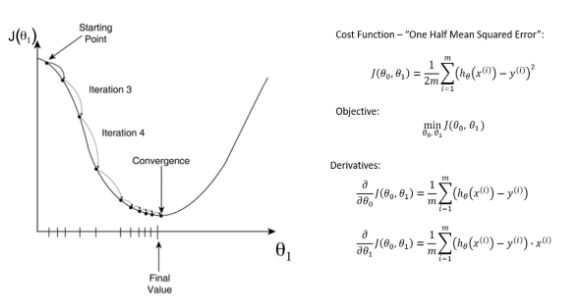

Gradient Descent é executado iterativamente para encontrar os valores ideais dos parâmetros correspondentes para ajudar a otimizar a função de custo. Matematicamente, a derivada nos ajuda a minimizar a função de custo e ajuda a determinar o ponto mínimo.